Atirador planeou atentado com inteligência artificial. O ChatGPT pode ser acusado de homicídio?

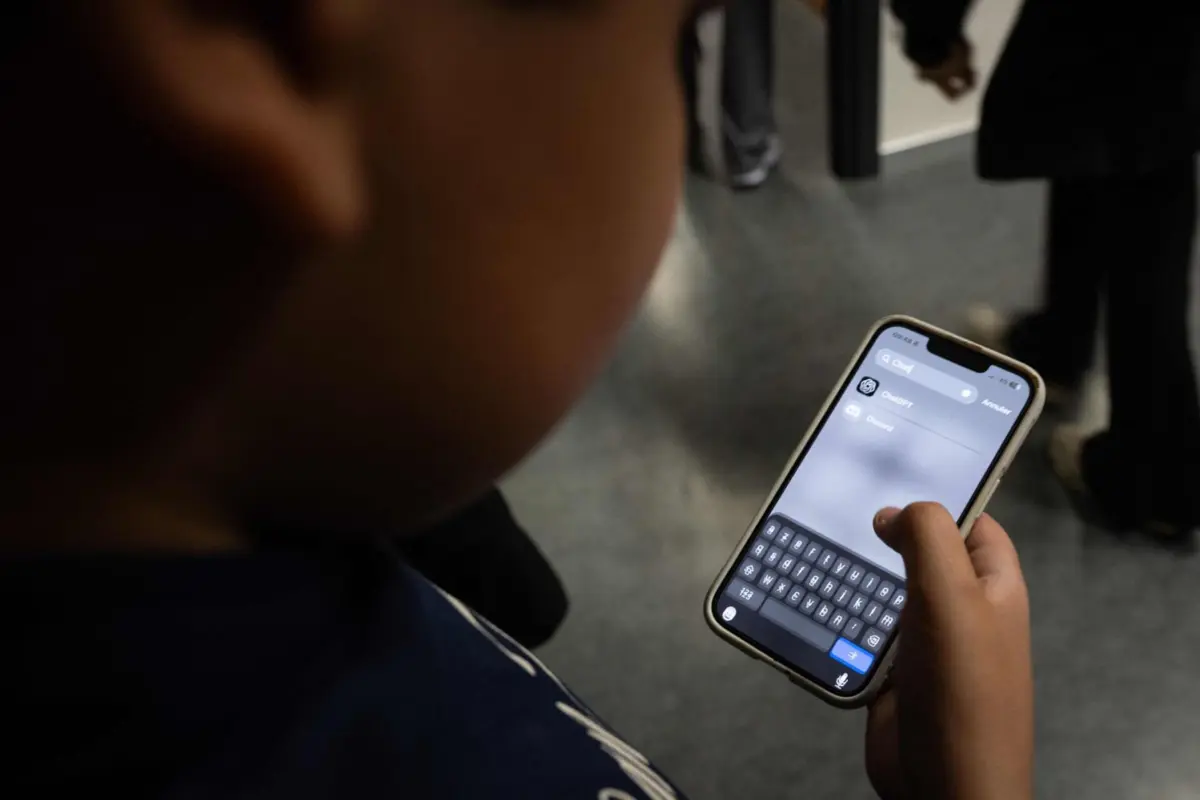

Foto: Sebastien Bozon/AFP

Antes de abrir fogo no campus da Universidade Estadual da Florida, no ano passado, matando duas pessoas e ferindo outras seis, Phoenix Ikner teve uma conversa. Não com um amigo, um dos pais ou qualquer pessoa que o pudesse ter dissuadido, mas com um chatbot de inteligência artificial (IA).

De acordo com as provas recolhidas pelo procurador-geral da Florida, o estudante perguntou ao ChatGPT que a arma e munições seriam mais adequadas para o ataque e quando e onde poderia causar o maior número de vítimas. O chatbot, segundo os investigadores, respondeu às perguntas.

Agora, o procurador-geral James Uthmeier quer saber se isso torna a OpenAI criminosa. “Se a coisa do outro lado do ecrã fosse uma pessoa, acusá-la-íamos de homicídio”, disse, anunciando uma investigação criminal contra a OpenAI, criadora do ChatGPT, e deixando em aberto a possibilidade de acusações contra a empresa ou os funcionários.

O caso do tiroteio de abril de 2025 trouxe à tona uma questão provocatória no âmbito jurídico: podem os criadores de uma IA ser responsabilizados criminalmente pelo papel que a sua IA desempenhou num crime – ou mesmo num suicídio? Os especialistas jurídicos afirmam que é uma proposta realista, embora profundamente complexa.

Leia também Jovem que matou oito pessoas numa escola planeou ataque no ChatGPT. Vítima processa empresa

Produto criminoso?

Os processos criminais contra empresas são possíveis ao abrigo da lei dos EUA, embora ainda sejam relativamente incomuns.

No final do mês passado, a Purdue Pharma foi condenada a pagar mais de cinco mil milhões de dólares (4,3 mil milhões de euros) em multas e penalizações criminais pelo seu papel no agravamento da crise dos opióides. A Volkswagen já tinha sido considerada culpada no escândalo de fraude nas emissões, a Pfizer pela promoção do medicamento anti-inflamatório Bextra e a Exxon pelo derrame de petróleo do Exxon Valdez no Alasca.

Mas todos estes casos envolviam decisões humanas – executivos, vendedores ou engenheiros que fizeram escolhas e negligenciaram procedimentos. O caso Ikner é diferente e essa diferença é precisamente o que o torna tão complexo do ponto de vista jurídico.

“Em última análise, foi um produto que incentivou este crime, que praticou o ato criminoso”, disse Matthew Tokson, professor de Direito na Universidade de Utah. “É isso que torna este caso tão singular e tão complexo”.

Especialistas jurídicos consultados pela AFP afirmam que as duas acusações mais plausíveis seriam negligência ou imprudência – esta última envolvendo uma escolha deliberada de ignorar riscos conhecidos ou obrigações de segurança. Tais acusações são frequentemente tratadas como delitos penais, e não como crimes graves, o que significa penas mais leves em caso de condenação.

No entanto, o nível de exigência é elevado. “Como se trata de uma questão tão inédita, um caso mais convincente e inequívoco envolveria provavelmente documentos internos que reconhecessem estes riscos e talvez não os levassem suficientemente a sério”, disse Tokson. “Em teoria, seria possível obter responsabilidade sem isso. Mas, na prática, acho que seria difícil.”

Leia também Pais culpam ChatGPT pelo suicídio de adolescente de 16 anos

No direito penal, “o ónus da prova é maior”, observou Brandon Garrett, professor de Direito na Universidade de Duke, exigindo que os procuradores estabeleçam a culpa para além de qualquer dúvida razoável.

A OpenAI, por sua vez, insiste que o ChatGPT não tem qualquer responsabilidade no ataque. “Trabalhamos continuamente para reforçar as nossas medidas de segurança para detetar intenções maliciosas, limitar o uso indevido e responder adequadamente quando surgem riscos de segurança”, afirmou a empresa.

Civil ou criminal?

Para aqueles que procuram responsabilização, um processo civil pode oferecer um caminho mais viável. Esta abordagem pode levar as empresas a conceber os seus produtos com mais cuidado – ou, pelo menos, forçá-las a lidar com o custo humano de cometer erros, disse Tokson.

Já foram interpostos vários processos civis contra plataformas de IA nos EUA – muitos envolvendo suicídios -, embora nenhum tenha resultado numa sentença contra as empresas.

Leia também Homem com doença rara depois de seguir conselho do ChatGPT sobre sal de cozinha

Em dezembro, a família de Suzanne Adams processou a OpenAI num tribunal da Califórnia, alegando que o ChatGPT contribuiu para o assassinato da reformada de Connecticut pelo seu próprio filho.

As versões mais recentes do ChatGPT introduziram salvaguardas adicionais, reconheceu Matthew Bergman, advogado fundador do Social Media Victims Law Center. “Não estou a dizer que são salvaguardas adequadas, mas há mais salvaguardas em vigor”, disse.

Uma condenação criminal, mesmo com uma pena moderada, pode ainda causar danos graves, incluindo um “grande impacto na reputação”, disse Tokson.

Mas, para Garrett, os processos judiciais – por mais dramáticos que sejam – não substituem os quadros regulamentares que o Congresso e a administração Trump ainda não conseguiram implementar. Isso, disse, seria “um sistema muito mais sensato”.